Anthropic anunció que usará tus conversaciones con Claude para entrenar sus modelos de IA. La compañía actualizó sus políticas de uso con nuevas cláusulas que le permitirán conservar los datos de sus usuarios hasta por cinco años y emplearlos como material de entrenamiento. Los cambios entrarán en vigor a finales de septiembre, por lo que deberás decidir si los aceptas o no.

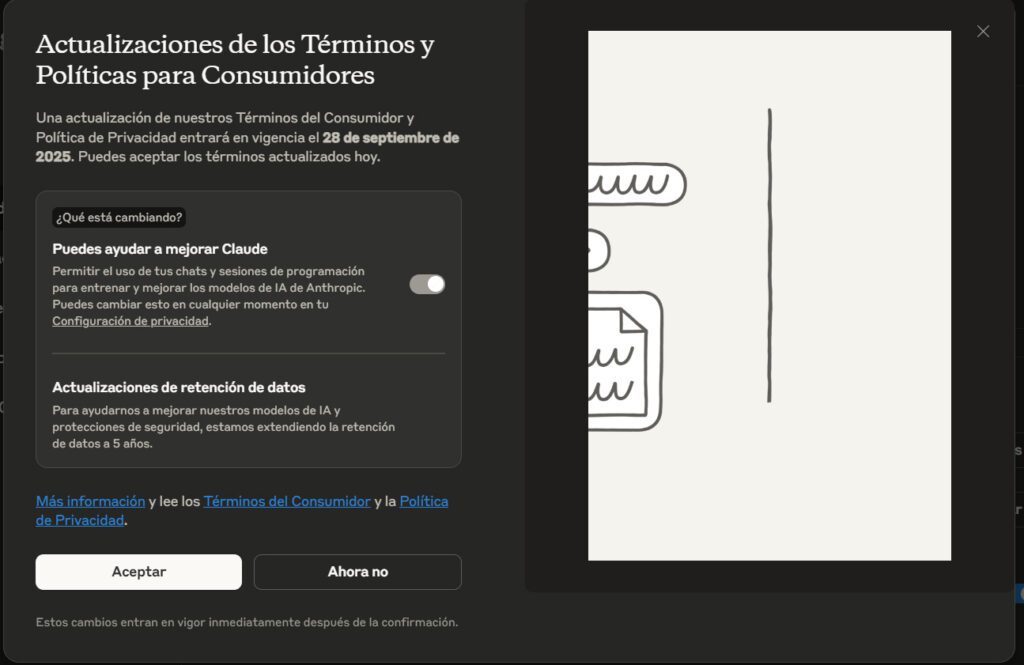

Si abres la app de Claude o accedes al chatbot desde la web, encontrarás una nueva ventana en donde se anuncia una actualización a los Términos del Consumidor. Esta pantalla incluye una opción para ayudar a mejorar Claude, la cual especifica que autorizas el uso de tus chats y sesiones de código para mejorar los modelos de Anthropic.

Esta característica, que se activa por defecto, implica que la compañía usará las transcripciones de tus conversaciones con la IA, incluido Claude Code. Los usuarios pueden desactivarla en esta ventana antes de aceptar la nueva política o hacerlo dentro de la configuración de privacidad de su cuenta.

Podemos usar sus Entradas y Salidas para entrenar nuestros modelos y mejorar nuestros Servicios, a menos que opte por no participar a través de la configuración de su cuenta. Incluso si opta por no participar, usaremos Entradas y Salidas para mejorar el modelo cuando:

- Sus conversaciones estén marcadas para revisión de seguridad para mejorar nuestra capacidad de detectar contenido dañino, hacer cumplir nuestras políticas o avanzar en la investigación de seguridad de IA.

- Nos haya informado explícitamente de los materiales (por ejemplo, a través de nuestros mecanismos de comentarios).

Cómo evitar que Anthropic use tus chats con Claude para entrenar su IA

Los nuevos Términos de Consumidor entrarán en vigor a partir del 28 de septiembre de 2025, aunque los usuarios pueden aceptarlos desde hoy y permitir que Claude acceda a su información. Si lo hiciste por error y no quieres que la empresa utilice tus chats, solo tienes que entrar a la página de tu perfil, seleccionar “Privacidad” en el menú lateral y desactivar la opción “Ayudar a mejorar Claude”. También puedes deshabilitar los metadatos de ubicación para que la empresa no sepa desde dónde utilizas la IA.

Si bien el uso de conversaciones para entrenar a Claude es opcional, los usuarios deberán aceptar un cambio en la retención de datos. Anthropic menciona que, con motivo de una mejora en las protecciones de seguridad, la compañía podrá retener tu información hasta por cinco años, incluidas todas las interacciones con sus sistemas.

Los cambios en Anthropic llegan a un día de que la empresa revelara que un hacker usó Claude en varios intentos de ciberataques y estafas. La compañía descubrió que una persona utilizó Claude Code para montar una operación de ransomware dirigida a 17 compañías. El actor malicioso se apoyó en la IA para definir la mejor estrategia para extraer datos, calcular el coste de la extorsión e incluso redactar las notas de rescate que se mostrarían en los ordenadores de las víctimas.

Anthropic publicó un informe con este y otros casos en los que personas superaron las barreras de seguridad de la IA para desarrollar malware. La empresa afirma que bloqueó las cuentas de los hackers e implementó actualizaciones para mitigar y evitar que se lleven a cabo nuevos intentos.